DeepSeek-Coder-V2

简介

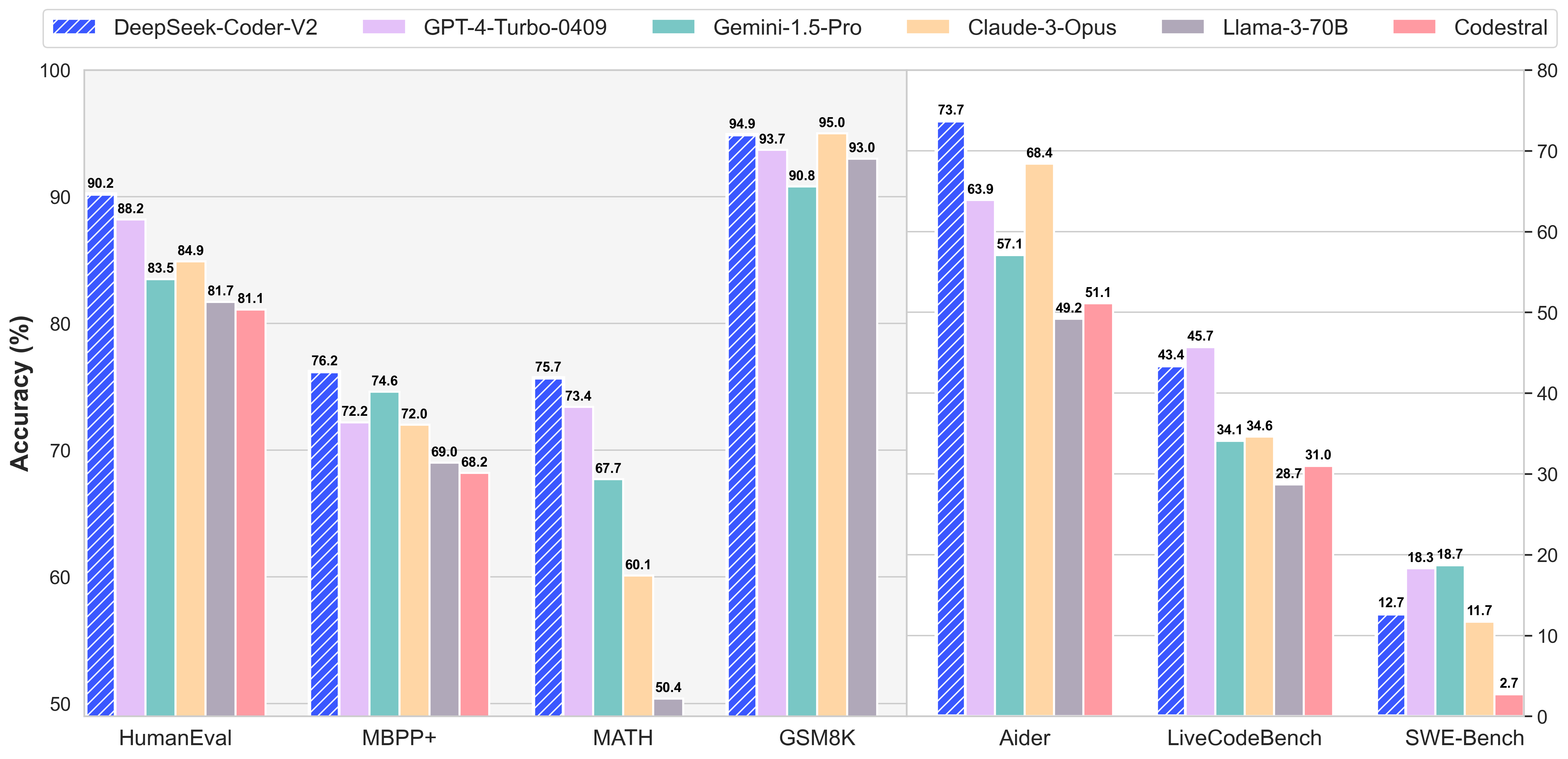

我们提出了 DeepSeek-Coder-V2,这是一个开源的混合专家 (MoE) 代码语言模型,在代码特定任务中实现了与 GPT4-Turbo 相当的性能。具体来说,DeepSeek-Coder-V2 从 DeepSeek-V2 的中间检查点进一步预训练,增加了 6 万亿个 token。通过这种持续的预训练,DeepSeek-Coder-V2 大幅增强了 DeepSeek-V2 的编码和数学推理能力,同时在一般语言任务中保持了相当的性能。与 DeepSeek-Coder-33B 相比,DeepSeek-Coder-V2 在代码相关任务的各个方面以及推理和通用能力方面都有了显著的进步。此外,DeepSeek-Coder-V2 将其对编程语言的支持从 86 种扩展到 338 种,同时将上下文长度从 16K 扩展到 128K。

在标准基准评估中,DeepSeek-Coder-V2 在编码和数学基准测试中的表现优于 GPT4-Turbo、Claude 3 Opus 和 Gemini 1.5 Pro 等闭源模型。

作者:Ddd4j 创建时间:2025-02-03 16:19

最后编辑:Ddd4j 更新时间:2026-02-27 09:37

最后编辑:Ddd4j 更新时间:2026-02-27 09:37